Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

我们用AI做图、修图时,经常会遇到一些难题:想把图中的杯子挪个位置,结果杯子变形了;想换个视角看看画面,透视却完全不对;想调整两个物体的前后位置,也会出现遮挡混乱、比例失衡……核心问题是AI更像是在平面上“P图”,无法理解图像背后的三维空间结构。

近日,京东探索研究院正式开源了自研的JoyAI-Image-Edit图像模型,彻底解决上述难题。这是业内首个把 “空间智能” 刻进骨子里的开源模型,让AI终于能真正 “看懂” 空间、“编辑” 空间,从原来的平面修图,升级成了三维空间重塑,而且模型的推理代码全部开放,开发者能直接拿

JoyAI-Image-Edit深度贴合真实世界空间规律,从空间位置关系、多视角一致性、相机感知到场景推理等维度全面建模,实现了相机坐标视角变换、物体空间位移旋转、几何结构精准控制等多项空间编辑技术突破,将空间认知能力深度融入文本与图像生成流程,搭建了完整的空间理解数据与任务体系。

该模型打破了AI“理解图像” 和 “生成图像” 的壁垒,让AI不仅能生成逼真的图像外观,更能精准理解图像背后的空间结构,在编辑过程中稳定保持主体形象与场景结构完整,多视角空间布局高度一致。不管是移动物体、换视角,还是调整物体间的关系,都能保持场景的几何规律,遮挡、光影也都自然合理,不会再出现变形、错乱的情况,彻底解决传统模型空间逻辑混乱的行业难题。

经实验验证,在物体移动精度、空间一致性等空间编辑核心指标上,JoyAI-Image-Edit达到世界一流水准。

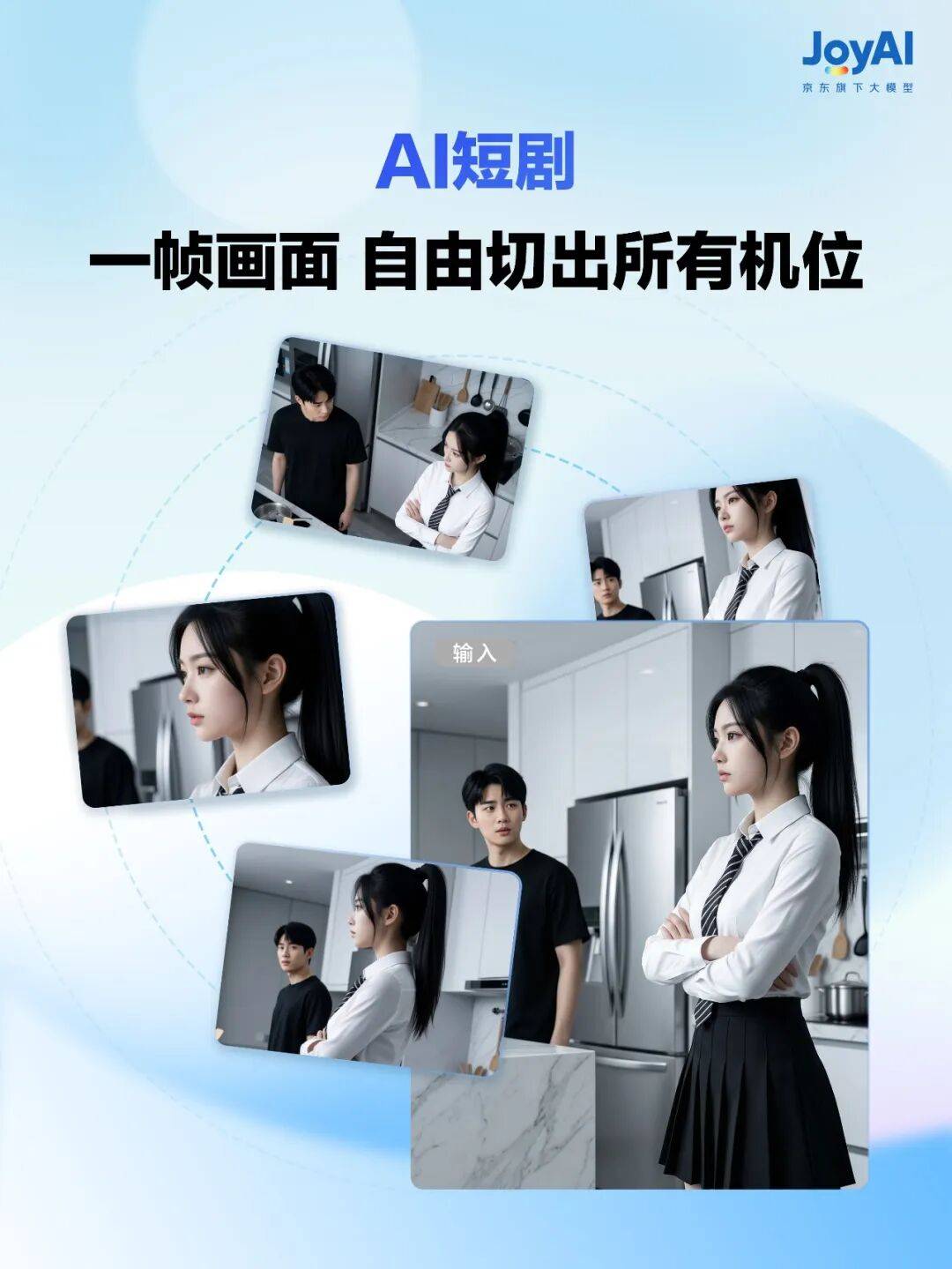

JoyAI-Image-Edit的核心跃升,在于其攻克了此前开源模型难以逾越的空间理解难题,具备三大辨识度极高的空间编辑能力:视角变换——用户可通过自然语言指定相机的偏航角、俯仰角及缩放程度,模型在保持场景几何一致性的前提下生成新视角图像;空间漫游——支持连续的视角移动,生成在空间中逻辑连贯的多视角图像序列,类似于在三维场景中"走动";物体空间关系操控——在保持场景整体结构稳定的前提下,对特定物体进行位移、缩放等空间变换,同时确保遮挡与光影关系自然合理。

在实现空间级突破的同时,JoyAI-Image-Edit全面兼容15类通用编辑能力,深度覆盖内容创作的高频需求。无论是物体的替换、删除、添加,还是整体风格迁移、细节精修等操作,模型均实现了高性能覆盖。结合顶尖的空间编辑技术,模型在长文本精准渲染、多视角一致性生成等行业高难度任务中表现卓越,真正做到了全场景、无死角的高效创作。

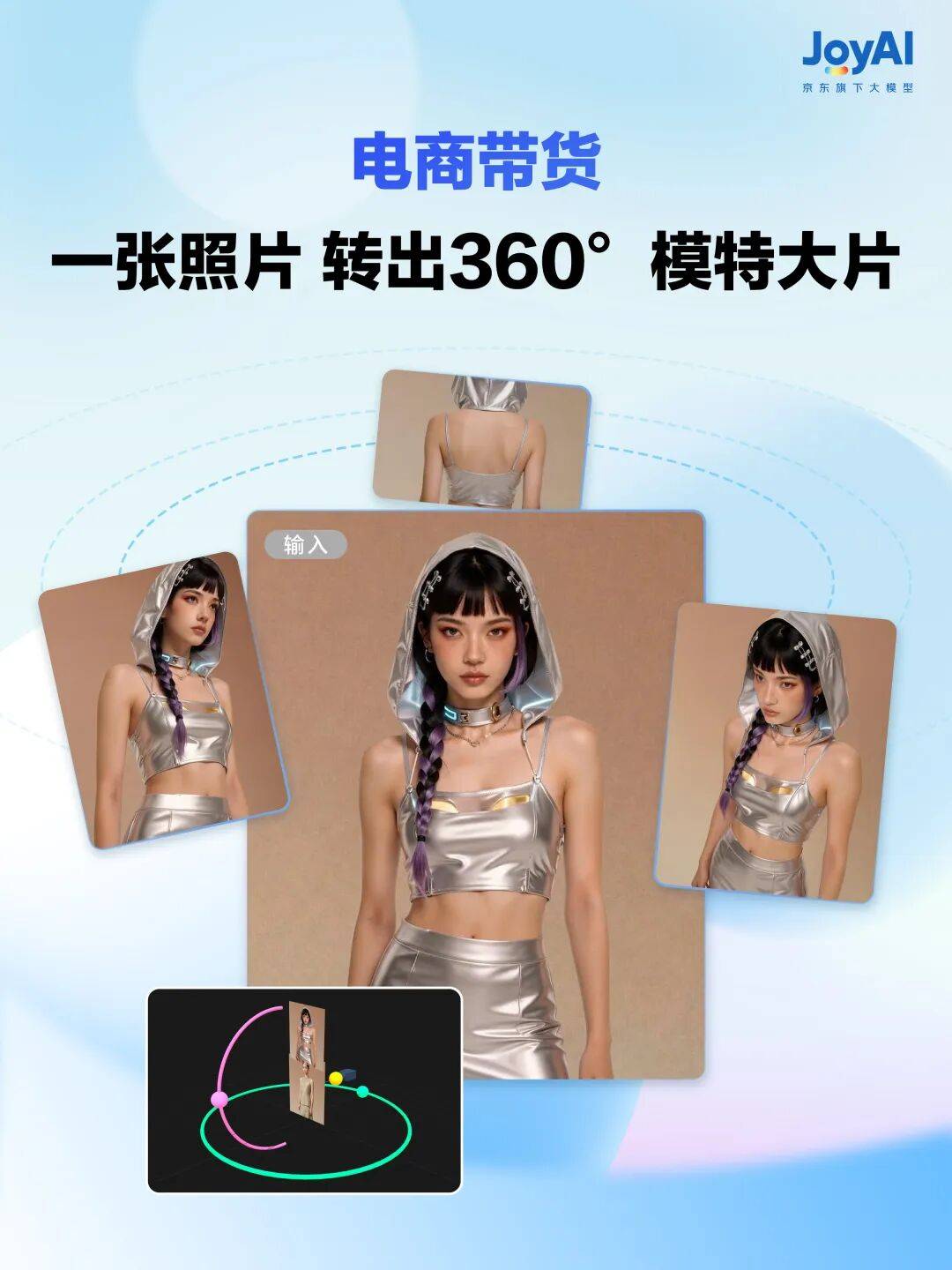

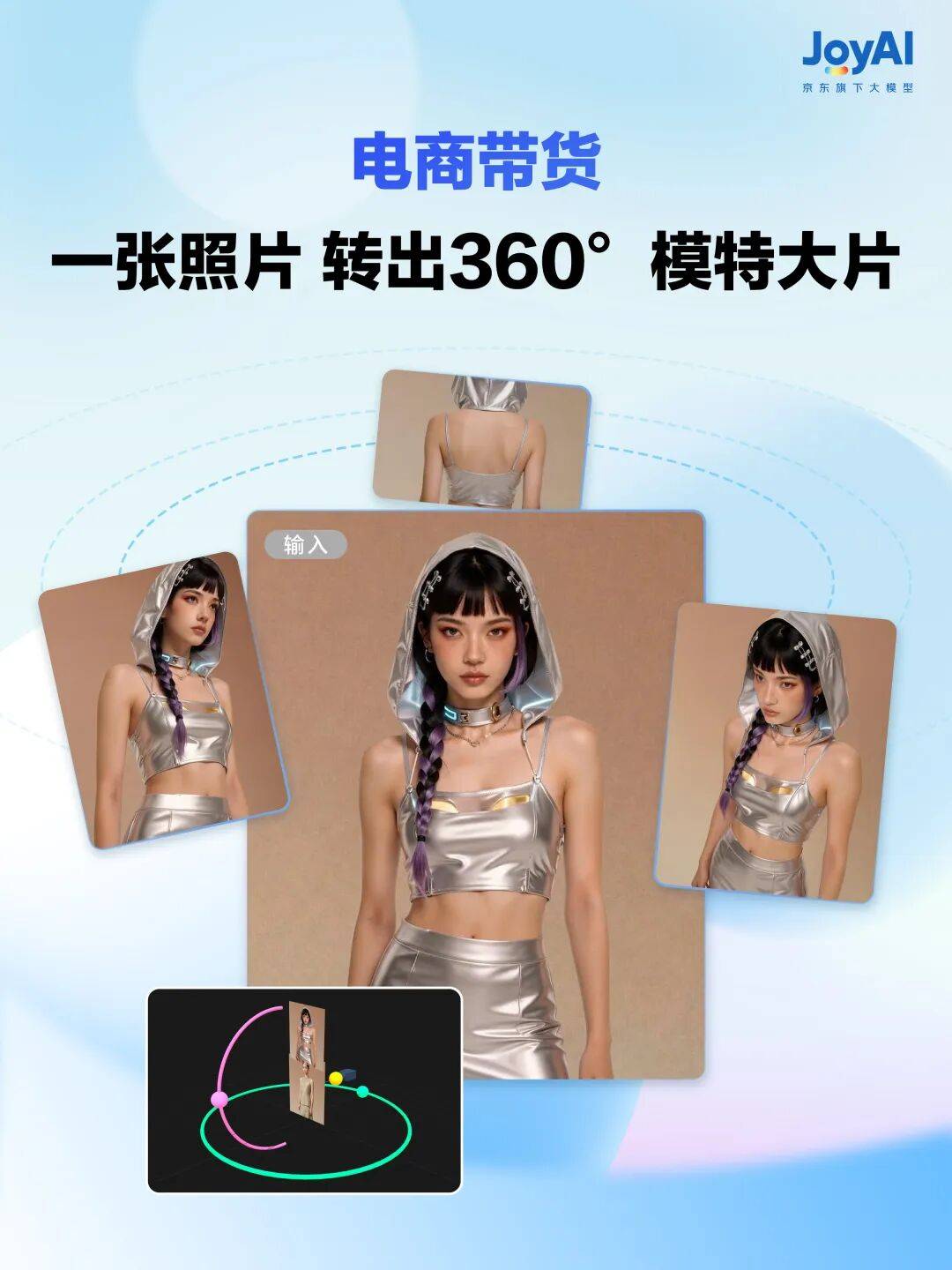

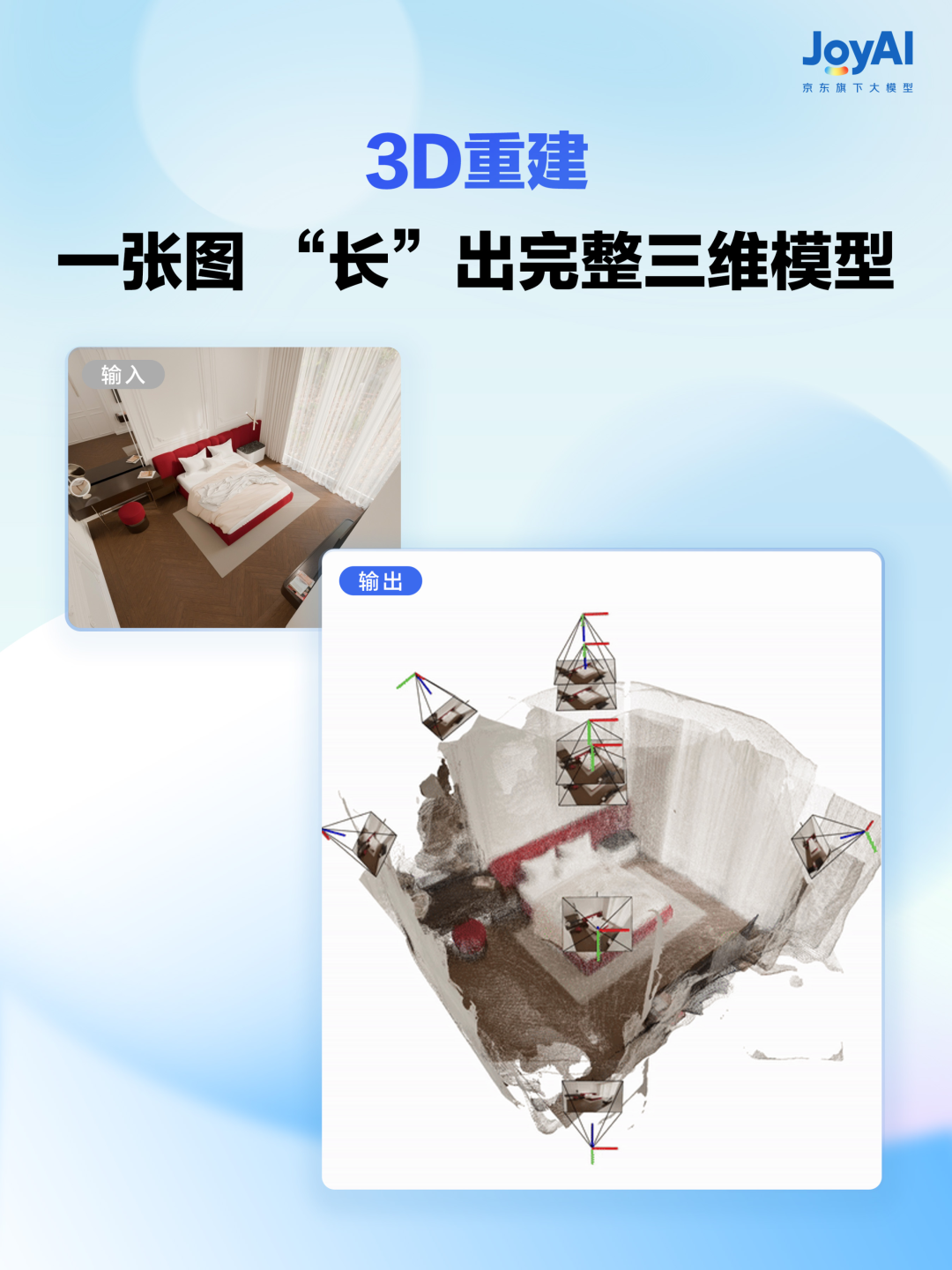

凭借领先的空间理解与编辑能力,JoyAI-Image-Edit模型突破场景限制,可广泛应用于电商内容生产、创意设计制作、智能图像处理、3D模型重建、具身智能视觉感知等多元领域,大幅提升AI图像技术在复杂空间场景中的适配性与实用性。尤其是在具身智能领域,空间理解能力是机器人“理解世界”的核心基础,而该模型的推出,也为相关技术研发提供了关键的底层能力。

此次JoyAI-Image-Edit的开源,是京东在AI多模态模型领域的重要布局,更是让AI图像编辑实现了从平面到空间的大跨越。未来该模型还将持续落地更多场景,不断探索空间智能落地价值。

在AI研发和应用领域,京东今年成果不断。过去一个月内,京东宣布首次开源基础大模型JoyAI-LLM Flash,打破了大模型参数内卷的困局;京东云“龙虾”系列产品集体上线,token调用量周环比增长高达455%;京东还宣布将建成全球最大的具身数据采集中心。依托超级供应链优势,京东将持续推动AI与产业深度融合,真正为产业创造价值。

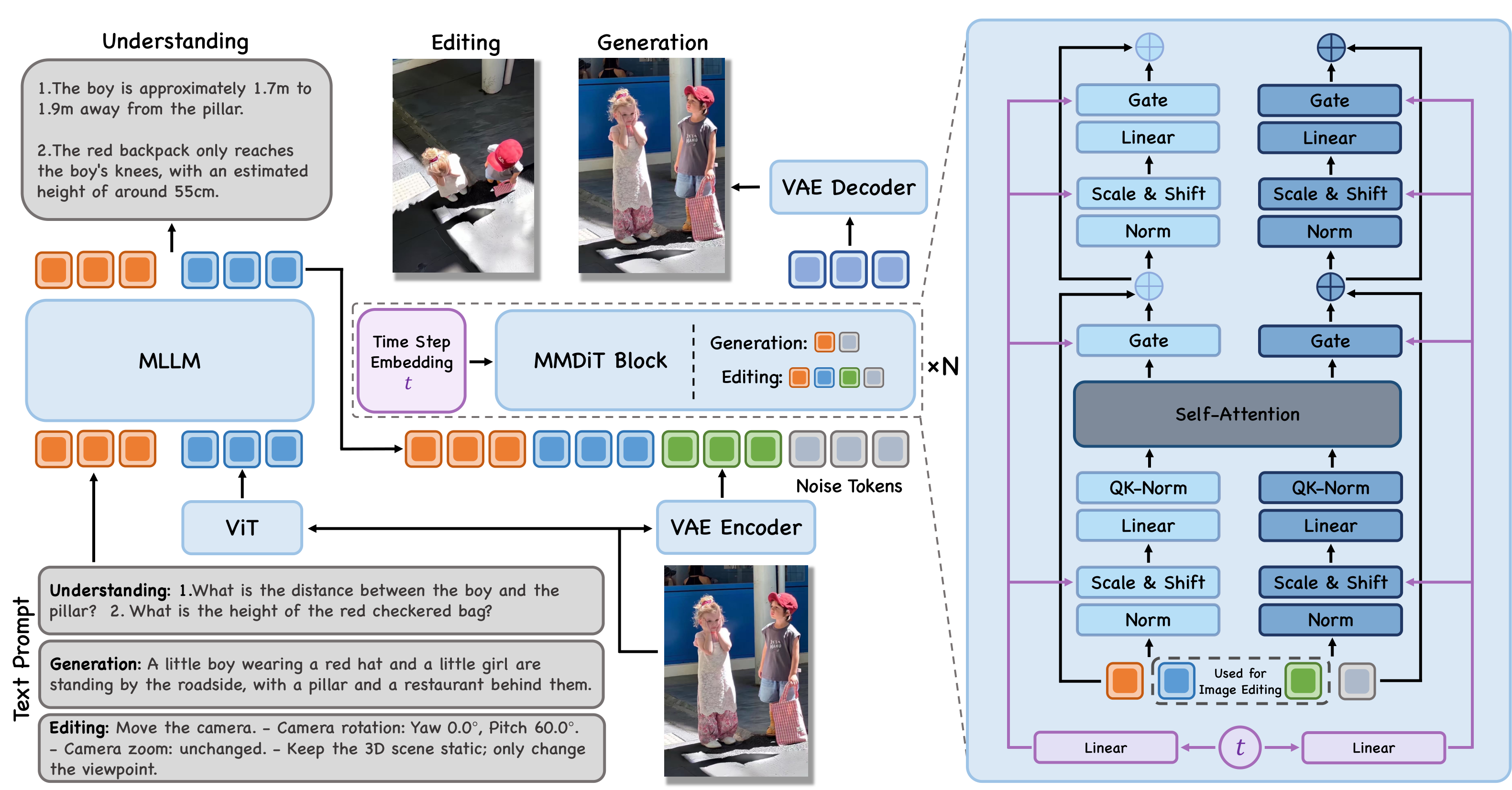

JoyAI-Image 是一个统一的多模态基础模型,用于图像理解、文本到图像的生成以及指令引导的图像编辑。它结合了 8 亿像素的多模态大型语言模型 (MLLM) 和 16 亿像素的多模态扩散变换器 (MMDiT)。JoyAI-Image 的核心原则是理解、生成和编辑之间的闭环协作。更强大的空间理解能力通过更优的场景解析、关系基础和指令分解来提升基于场景的生成和可控的编辑,而诸如视角变化之类的生成变换则为空间推理提供了补充证据。

| 模型 | 任务 | 描述 | 下载链接 |

|---|---|---|---|

| JoyAI-Image-Und | 多模态理解 | 一个能够实现高保真空间推理和编辑感知的文本-图像理解主干。 | 🤗拥抱脸 |

| JoyAI图像编辑 | 图像编辑 | 一种具有精确可控空间操作的指令引导式图像编辑模型。 | 🤗拥抱脸🤖模型范围 |

| JoyAI图像编辑精简版 | 图像编辑 | JoyAI图像编辑的精简版,推理速度更快 | 即将发布 |

| JoyAI图像编辑增强版 | 多图编辑 | 支持多图像编辑的指导式模型,可实现跨图像合成、一致性和联合操作。 | 即将发布 |

| JoyAI-图像 | 文本转图像 | 具有很强的多视角一致性的高质量文本到图像生成模型。 | 即将发布 |

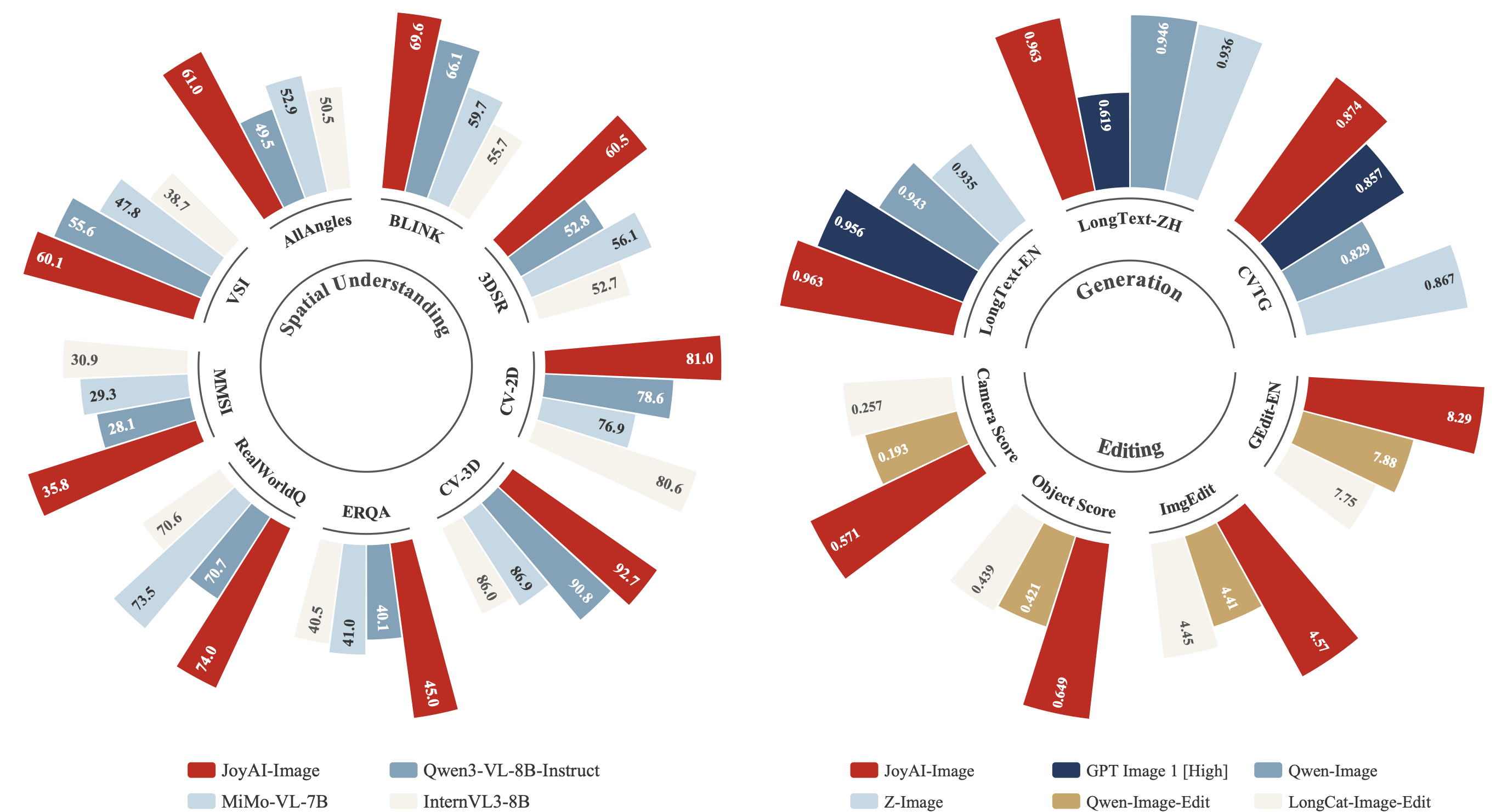

JoyAI-Image 在理解、合成和编辑方面展现出广泛的多模态性能,尤其在空间推理、长文本渲染、多视图生成和可控编辑方面具有优势。

JoyAI-Image 针对具有挑战性的文本密集型场景进行了优化,包括多格漫画、密集的多行文本、多语言排版、长篇布局、真实场景文本和手写风格。

JoyAI-Image 展示了一个基于空间的生成和编辑流程,支持多视角生成、几何感知变换、相机控制、物体旋转以及精确的、特定位置的物体编辑。在这些设置下,它能够保持场景内容、结构和视觉一致性,同时更准确地遵循视点相关的指令。

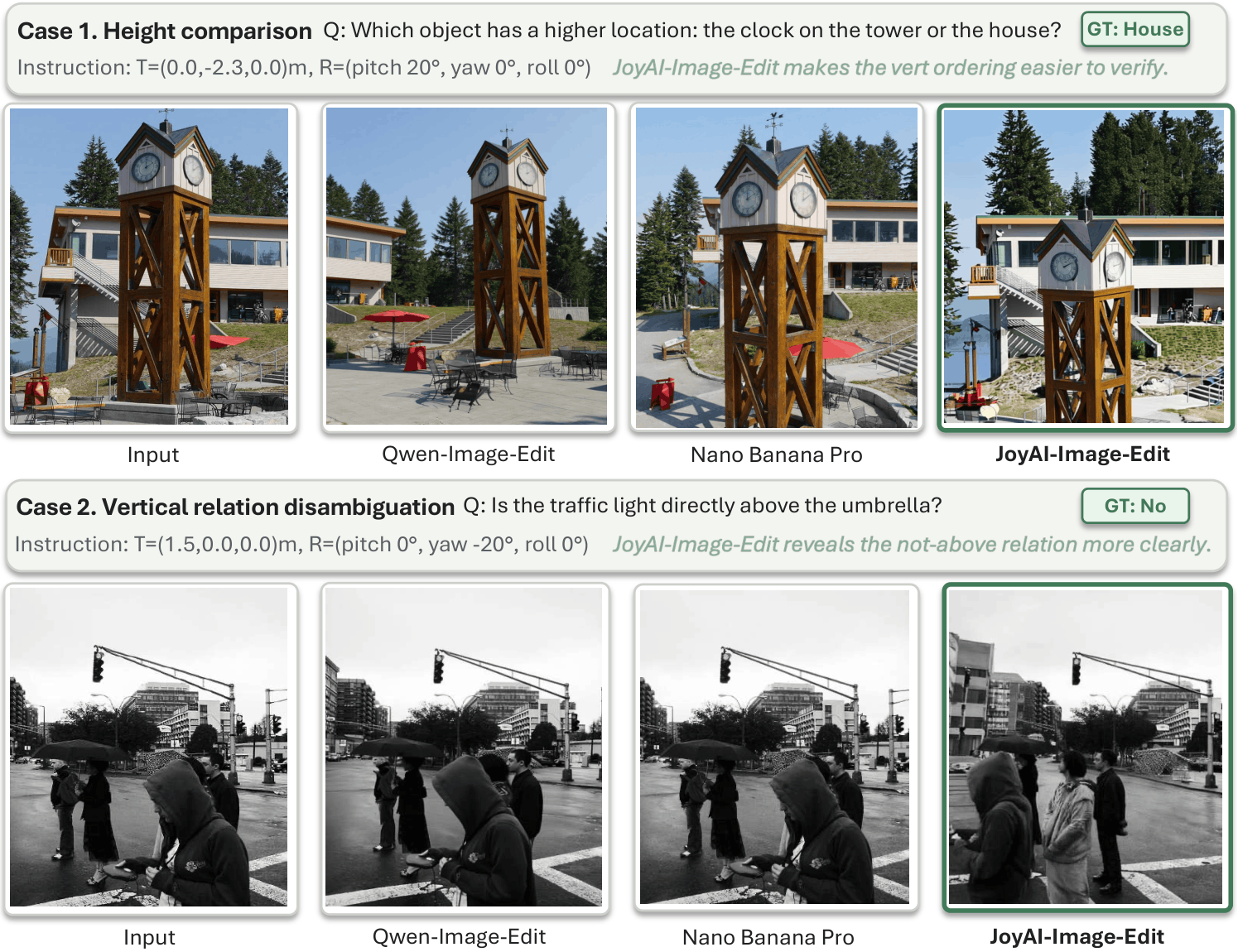

JoyAI-Image 提供高保真度的空间编辑功能,是增强空间推理能力的有力催化剂。与 Qwen-Image-Edit 和 Nano Banana Pro 相比,JoyAI-Image-Edit 通过忠实地执行相机运动,合成最具诊断意义的视角。这些高保真度的新颖视角能够有效消除复杂空间关系的歧义,为后续推理提供更清晰的视觉证据。

要求:Python 版本 >= 3.10,支持 CUDA 的 GPU

创建虚拟环境并安装:

conda create -n joyai python=3.10 -y

conda activate joyai

pip install -e .关于 Flash Attention 的说明:

flash-attn >= 2.8.0为了获得最佳性能,Flash Attention 被列为依赖项。

| 包裹 | 版本 | 目的 |

|---|---|---|

torch | ≥ 2.8 | PyTorch |

transformers | 版本 >= 4.57.0,< 4.58.0 | 文本编码器 |

diffusers | 版本 >= 0.34.0 | 管道公用事业 |

flash-attn | 版本 >= 2.8.0 | 快速注意力核 |

python inference_und.py \

--ckpt-root /path/to/ckpts_infer \

--image "test_images/test_1.jpg,test_images/test3.png" \

--prompt "Compare these two images." \

--max-new-tokens 1024| 争论 | 类型 | 默认 | 描述 |

|---|---|---|---|

--ckpt-root | 斯特 | 必需的 | 检查点根包含text_encoder/ |

--image | 斯特 | 必需的 | 输入图像路径,或以逗号分隔的多幅图像路径。 |

--prompt | 斯特 | "Describe this image in detail." | 用户提问或说明。如果省略,则默认为图像说明文字。 |

--max-new-tokens | 整数 | 2048 | 要生成的最大代币数量 |

--temperature | 漂浮 | 0.7 | 采样温度。0用于贪婪解码 |

--top-p | 漂浮 | 0.8 | Top-p(核)采样阈值 |

--top-k | 整数 | 50 | Top-k采样阈值 |

--output | 斯特 | 没有任何 | 可选的输出文件,用于保存响应文本 |

python inference.py \

--ckpt-root /path/to/ckpts_infer \

--prompt "Turn the plate blue" \

--image test_images/test_1.jpg \

--output outputs/result.png \

--seed 123 \

--steps 30 \

--guidance-scale 5.0 \

--basesize 1024| 争论 | 类型 | 默认 | 描述 |

|---|---|---|---|

--ckpt-root | 斯特 | 必需的 | 检查点根 |

--prompt | 斯特 | 必需的 | 编辑指令或 T2I 提示 |

--image | 斯特 | 没有任何 | 输入图像路径(编辑时必需,T2I 时省略) |

--output | 斯特 | example.png | 输出图像路径 |

--steps | 整数 | 50 | 去噪步骤 |

--guidance-scale | 漂浮 | 5.0 | 无分类器指导尺度 |

--seed | 整数 | 42 | 为了保证可复现性,使用了随机种子。 |

--neg-prompt | 斯特 | "" | 否定提示 |

--basesize | 整数 | 1024 | 输入图像缩放的桶基本大小(256/512/768/1024) |

--config | 斯特 | 汽车 | 配置路径;默认为<ckpt-root>/infer_config.py |

--rewrite-prompt | 旗帜 | 离开 | 启用基于LLM的提示符重写 |

--rewrite-model | 斯特 | gpt-5 | 提示重写的模型名称 |

--hsdp-shard-dim | 整数 | 1 | 多GPU的FSDP分片维度(设置为GPU数量) |

JoyAI-Image 支持三种空间编辑提示模式:物体移动、物体旋转和相机控制。为了获得最稳定的性能,我们建议您尽可能严格地遵循以下提示模板。更多信息(包括数据整理和评估策略),请参阅SpatialEdit。

当您想将目标对象移动到指定区域时,请使用此模式。

提示模板:

Move the <object> into the red box and finally remove the red box.

规则:

<object>请用对要移动的目标对象的清晰描述来替换。例子:

Move the apple into the red box and finally remove the red box.

当您想将对象旋转到特定的标准视图时,请使用此模式。

提示模板:

Rotate the <object> to show the <view> side view.

支持的<view>值:

front, right, left, rear, front right, front left, rear right, rear left

规则:

<object>请用对要旋转的物体的清晰描述来替换。<view>为以上支持的方向之一。例如:

Rotate the chair to show the front side view.

Rotate the car to show the rear left side view.

当您只想改变相机视角而保持 3D 场景本身不变时,请使用此模式。

提示模板:

Move the camera.

- Camera rotation: Yaw {y_rotation}°, Pitch {p_rotation}°.

- Camera zoom: in/out/unchanged.

- Keep the 3D scene static; only change the viewpoint.

规则:

{y_rotation}以度为单位指定偏航旋转角度。{p_rotation}指定俯仰旋转角度,单位为度。Camera zoom必须是以下之一:in,,outunchanged例如:

Move the camera.

- Camera rotation: Yaw 45°, Pitch 0°.

- Camera zoom: in.

- Keep the 3D scene static; only change the viewpoint.

Move the camera.

- Camera rotation: Yaw -90°, Pitch 20°.

- Camera zoom: unchanged.

- Keep the 3D scene static; only change the viewpoint.

三维重建:

第一个例子和第三个例子展示了仅包含单个给定视点的点云。第二个例子和第四个例子则通过SpatialEdit进行了增强,SpatialEdit 可以从稀疏的输入视图中合成更丰富的空间观测数据。

基于条件帧的视频生成:

给定第一帧,SpatialEdit首先生成视频的最后一帧,然后视频生成模型在保持背景一致性的同时,在它们之间创建平滑的旋转过渡。

JoyAI-Image 采用 Apache 2.0 许可。